vía Hipertextual

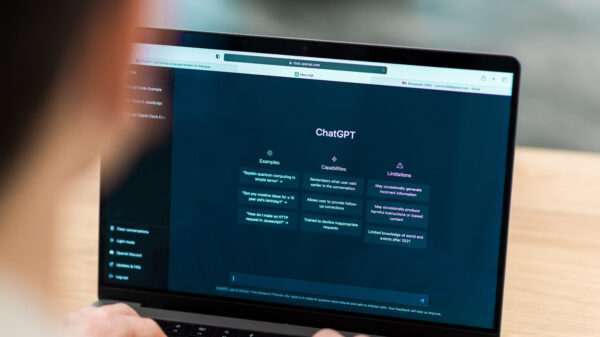

La próxima semana conoceremos GPT-4, la próxima generación del popular modelo de lenguaje de inteligencia artificial. Desde Microsoft adelantan que será multimodal.

Sabíamos que GPT-4 sería presentado, con mucha probabilidad, durante el primer semestre de 2023. Afortunadamente, OpenAI no decepcionará en este sentido. Microsoft, uno de los principales inversores de la startup especializada en inteligencia artificial, ha confirmado que el mundo conocerá el nuevo modelo de lenguaje la próxima semana. De momento, eso sí, no revelaron el día específico.

Si bien gran parte de las novedades técnicas se las guardarán hasta el anuncio oficial, los de Redmond ya han adelantado un detalle clave: GPT-4 será multimodal.

¿Que quiere decir que un modelo de lenguaje sea multimodal? Básicamente, que puede interpretar tanto texto como imágenes. La versión anterior, que da vida a ChatGPT, solo es capaz de producir textos.

Con GPT-4, por lo tanto, sería posible generar texto, imágenes, vídeos e incluso música. Andreas Braun, director de tecnología de Microsoft Alemania, se pronunció al respecto en declaraciones recogidas por Heise:

«Presentaremos GPT-4 la próxima semana. Tendremos modelos multimodales que ofrecerán posibilidades completamente diferentes. Por ejemplo, vídeos.»Andreas Braun.

Braun describió GPT-4 como un game changer para el sector de la inteligencia artificial, ya que el modelo de lenguaje dará otro paso para acercarse a la capacidad de interpretación humana. Evidentemente, para igualarla todavía le queda un largo trayecto.

Otro de los beneficios de GPT-4 como lenguaje multimodal es que podrá gestionar la entrada y salida de datos en diferentes idiomas. Trasladando esta posibilidad a ChatGPT, podrías realizar la petición en español, pero que el texto generado se encuentre en inglés. Evidentemente, esta novedad también sería de gran ayuda para las herramientas de traducción.

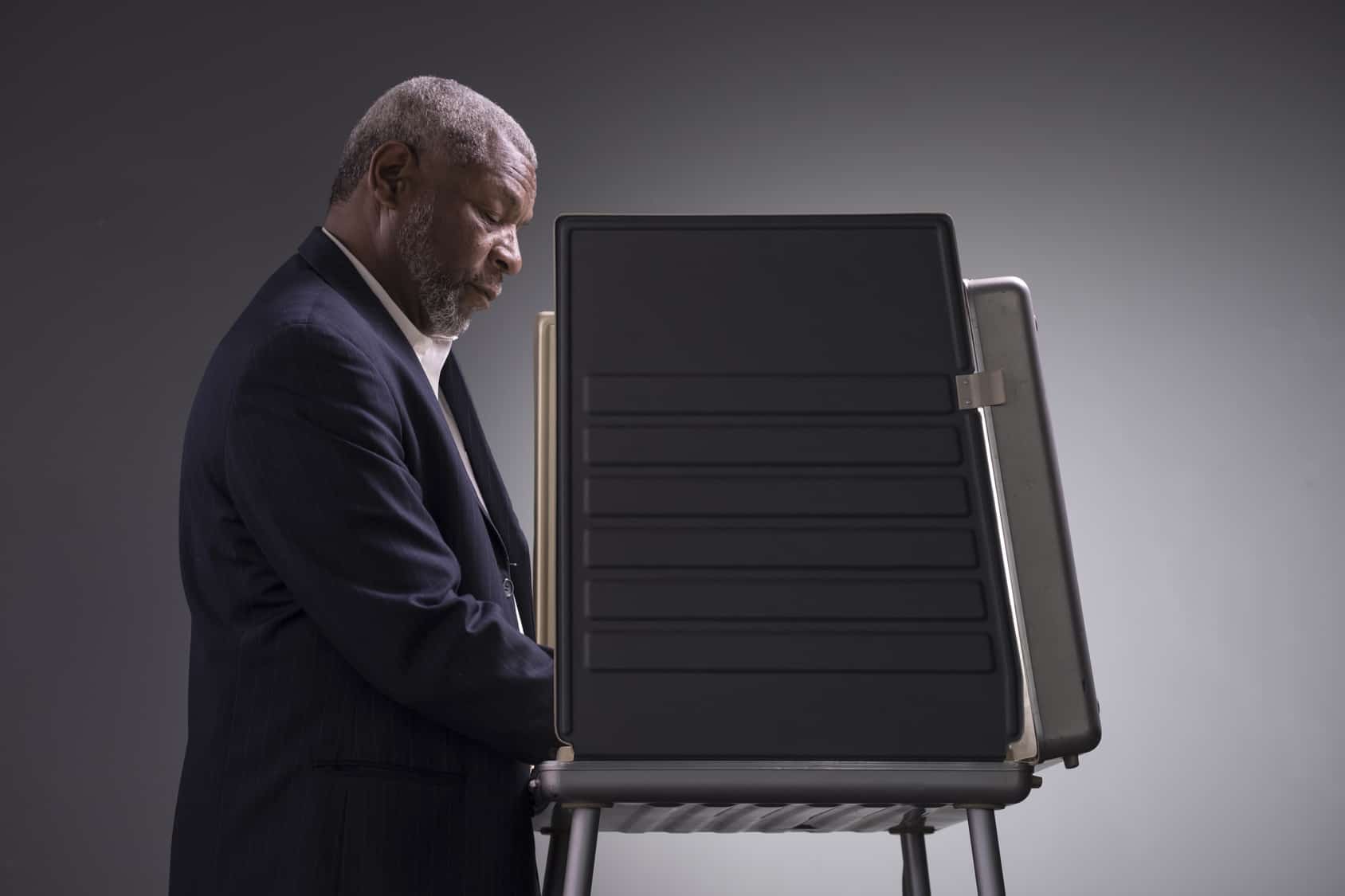

Desde Microsoft reiteran que el impacto de ChatGPT en la vida diaria de tantas personas es similar al que provocó el iPhone hace más de una década. No obstante, la popularidad del chatbot no frenó sus aspiraciones de seguir mejorando el modelo de lenguaje que lo hace posible. Por ello la gran atención que le están dedicando a la presentación de GPT-4.

Asimismo, la compañía dirigida por Saya Nadella ha dejado claro que GPT-4 no llega para robarse los empleos de las personas. Por ejemplo, aquellos que trabajan en medios de comunicación escrito. El objetivo principal es simplificar o potenciar su trabajo, no quitárselos.

«No se trata de reemplazar puestos de trabajo, sino de hacer tareas repetitivas de una manera diferente a como se hacía antes.»Andreas Braun.

De hecho, en Microsoft recomiendan a las empresas capacitar a sus empleados sobre la adopción de la inteligencia artificial en la vida laboral. «Las descripciones de trabajo tradicionales están cambiando. Están surgiendo nuevas y emocionantes profesiones producto del enriquecimiento de las nuevas posibilidades [impulsadas por la IA]», comentó Marianne Janik, directora de Microsoft Alemania.

Microsoft podría aprovechar GPT-4 en Kosmos-1, su nueva IA

Apenas a principios de marzo, Microsoft presentó Kosmos-1, una inteligencia artificial que promete analizar texto, imágenes, vídeo y audio, y posteriormente seguir instrucciones con base en esa interpretación. Precisamente, Kosmos-1 se apoya en un modelo de lenguaje extenso multimodal (MLLM). Por lo tanto, esta IA igualmente podría sacar provecho de GPT-4.

Indudablemente, lo que OpenAI nos muestra la próxima semana puede marcar un hito más en la carrera de la inteligencia artificial. Si GPT-3 y GPT-3.5 ya dejaron asombrado al mundo entero, lo que GPT-4 puede lograr es incluso más prometedor.